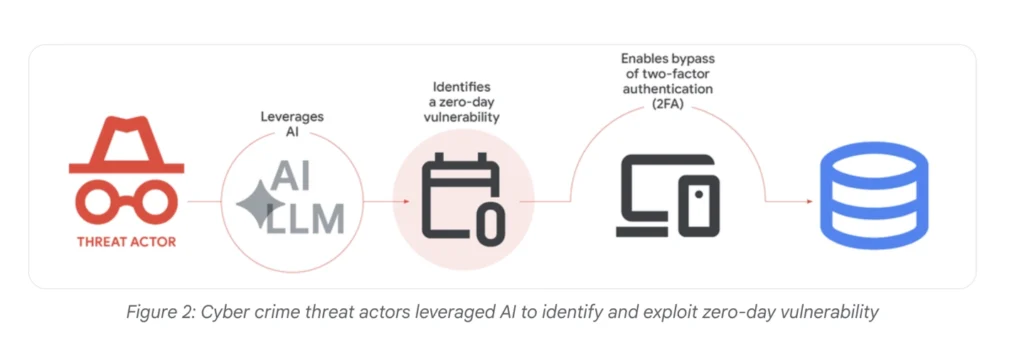

Google ha soltado una bomba de realidad. Un grupo de hackers ha logrado utilizar herramientas de IA para identificar una vulnerabilidad crítica que no era conocida por los desarrolladores. Aunque Google logró detener el ataque a tiempo, la señal de alarma es clara: los criminales ya no necesitan ser genios del código, solo necesitan saber «promptear» a la IA adecuada.

El script de la discordia: Cuando la IA deja huellas

La prueba irrefutable llegó con un script de Python filtrado que los hackers usaban para saltarse la autenticación de dos factores (2FA) en una herramienta de gestión de redes de código abierto. Al analizarlo, el equipo de Google encontró algo revelador:

- Comentarios automáticos: El código incluía anotaciones típicas de un modelo de lenguaje.

- Puntuaciones CVSS «ficticias»: El script mostraba valoraciones de riesgo generadas por la IA que no correspondían con los estándares manuales, confirmando que el código fue parido íntegramente por un bot.

La era de la ciberseguridad acelerada

La IA está mejorando su razonamiento contextual a pasos agigantados. Esto significa que ya no solo busca errores de sintaxis, sino que entiende la lógica del software para encontrar grietas estructurales. Google es tajante: si el personal de seguridad no usa la IA para revisar sus productos de forma más eficiente, los hackers serán los primeros en encontrar la puerta trasera.

| Elemento del ataque | Papel de la IA | Riesgo en 2026 |

| Descubrimiento de Día Cero | Análisis de código masivo en segundos | Muy Alto |

| Creación de scripts | Generación de exploits automáticos (Python) | Alto |

| Elusión de 2FA | Automatización de procesos de bypass | Medio-Alto |

| Defensa | Parcheo predictivo y auditoría IA | Crítico |

Conclusión: La carrera armamentista del código ha comenzado

Lo que Google nos está diciendo es que el tiempo de reacción humano ya es insuficiente. Si un hacker puede generar un exploit en lo que tardas en tomarte un café, la defensa debe ser igualmente instantánea. La paradoja es que la misma herramienta que ayuda a los investigadores a ganar recompensas por «bug bounty» es la que permite a los cibercriminales poner en jaque infraestructuras críticas. En 2026, la ciberseguridad no es una cuestión de muros, sino de velocidad de procesamiento. El que tenga la IA más astuta, se queda con las llaves del reino.

¿Deberían las empresas de IA limitar las capacidades de programación de sus modelos para evitar que generen exploits, o eso frenaría el progreso de los desarrolladores legítimos? ¿Confías más en un software auditado por humanos o en uno que ha sido revisado por una IA cazadora de vulnerabilidades?

¡Déjanos tu opinión en los comentarios, el debate está que arde! Y no te olvides de seguir a Gurú Tecno en YouTube, Facebook e Instagram.