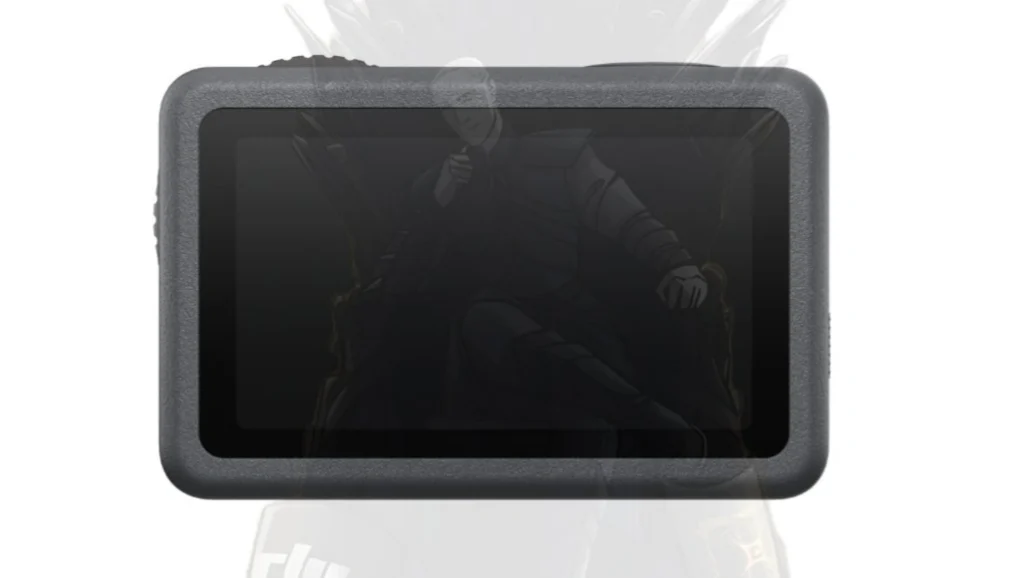

¡Atención, Gurú Tecno Army! El mundo de la imagen está a punto de dar un giro radical. Según un informe publicado este mes por el medio especializado en tecnología Photo Rumors, Fujifilm presentó recientemente una “cámara sin lente” en la conferencia “Romanticismo Industrial” celebrada en Roppongi, Tokio. Esta cámara carece por completo de lente tradicional y es capaz de reconstruir imágenes nítidas mediante algoritmos de inteligencia artificial.

Según los informes, esta cámara fue diseñada por el diseñador de productos Yoshimura Tashi, y su propósito inicial era servir como un sistema de gestión de imágenes, ayudando a los usuarios a buscar rápidamente imágenes específicas en sus teléfonos utilizando palabras clave como «cara sonriente» y «coche».

Yoshimura Tashi afirmó estar fascinado por la idea de «abandonar las formas tradicionales y crear nuevo valor». Comparó esta innovación con los fideos instantáneos en vaso o la cámara desechable, que revolucionaron sus respectivos campos.

¿Cómo funciona una «cámara sin lentes»?

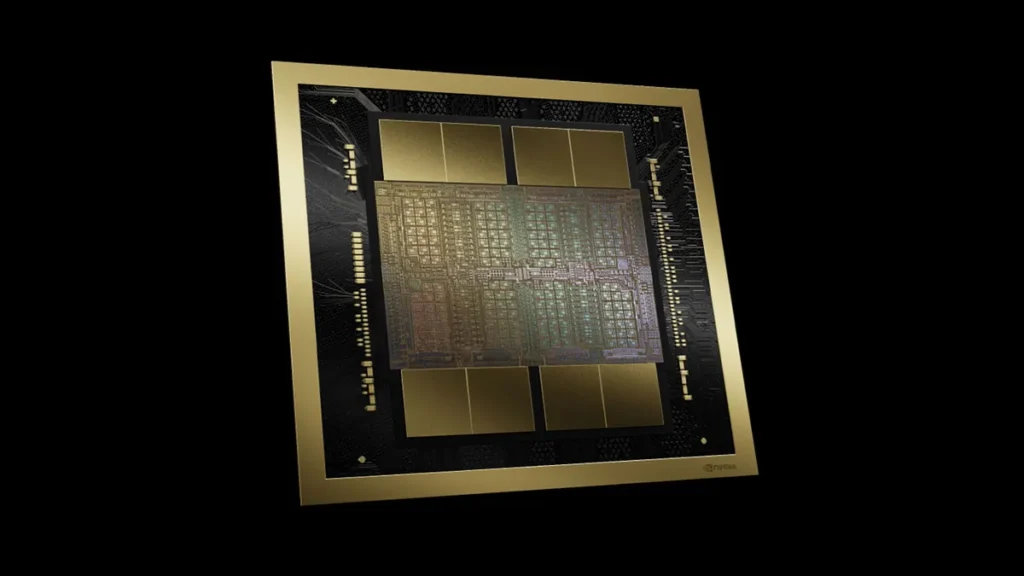

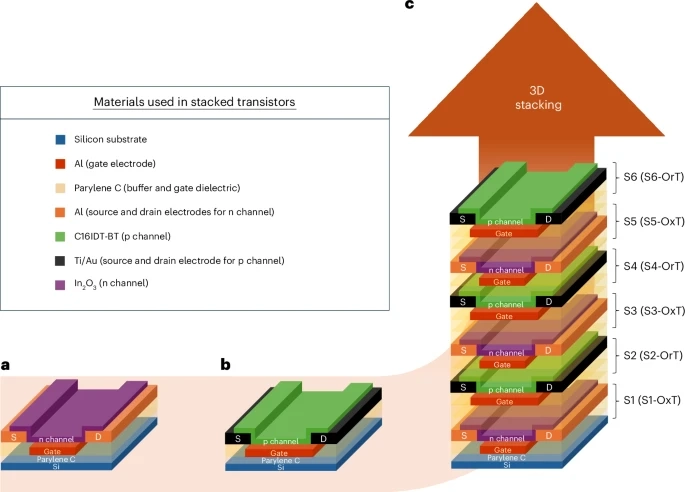

En cuanto al hardware, esta cámara utiliza un dispositivo de modulación de fase óptica en lugar de un sistema de lentes múltiples tradicional. Sin embargo, cuando la luz pasa a través de este dispositivo, no produce una imagen nítida, sino que deja una mancha borrosa en el sensor. Es en este punto donde el algoritmo de IA interviene y utiliza la información de la escena contenida en la mancha para calcular una fotografía nítida.

Aplicaciones potenciales: más allá de la fotografía y con privacidad

En cuanto a sus posibles aplicaciones, si bien esta cámara no fue diseñada para tomar fotografías convencionales, se espera que:

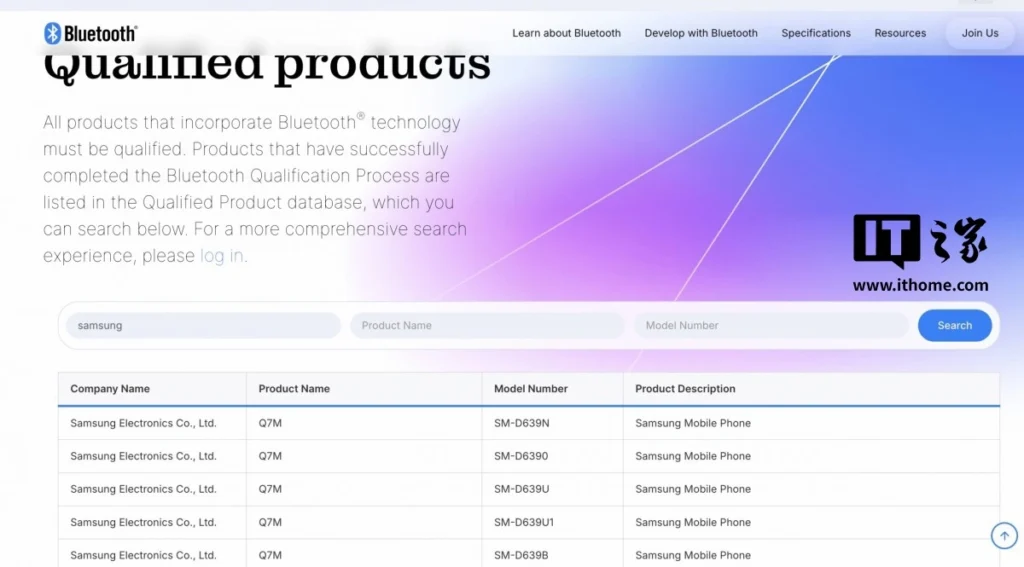

- Permita fabricar módulos de lentes para teléfonos inteligentes más delgados.

- Proporcione módulos de reconocimiento visual específicos para la tecnología de conducción autónoma.

- Logre la protección de la privacidad en el ámbito de la seguridad.

Este último punto es crucial: los datos sin procesar registrados son solo un punto de luz borroso, que solo puede descifrarse para obtener una imagen nítida tras la autorización. Esto abre la puerta a sistemas de captura de imágenes con una capa de privacidad integrada desde la base.

Sin embargo, cabe destacar que la cámara expuesta es solo un prototipo y aún no ha llegado a la fase de producción en masa.

Como vemos, la «cámara sin lentes» de Fujifilm es una de esas innovaciones que nos recuerdan el poder transformador de la inteligencia artificial. Al reemplazar la óptica tradicional con modulación de fase y reconstrucción por IA, Fujifilm no solo está explorando un nuevo paradigma en la captura de imágenes, sino que también está abordando desafíos clave en miniaturización y privacidad. Este prototipo, aunque lejano de ser un producto de consumo masivo, sienta las bases para futuras aplicaciones que podrían revolucionar desde la fotografía móvil hasta la visión artificial en vehículos autónomos y sistemas de seguridad.

¡El futuro de la imagen es borroso… hasta que la IA lo aclare! ¡Te leemos en los comentarios! Y no te olvides de seguir a Gurú Tecno en YouTube, Instagram y Facebook.