Confesadlo: ¿cuántas veces habéis pegado en ChatGPT unos resultados de análisis que no entendíais o le habéis preguntado por un síntoma raro? Pues bien, OpenAI ha decidido dejar de mirar para otro lado y oficializar esta realidad. Preparaos, porque vuestro chatbot favorito acaba de sacarse el título de «asistente sanitario». Nace ChatGPT Health.

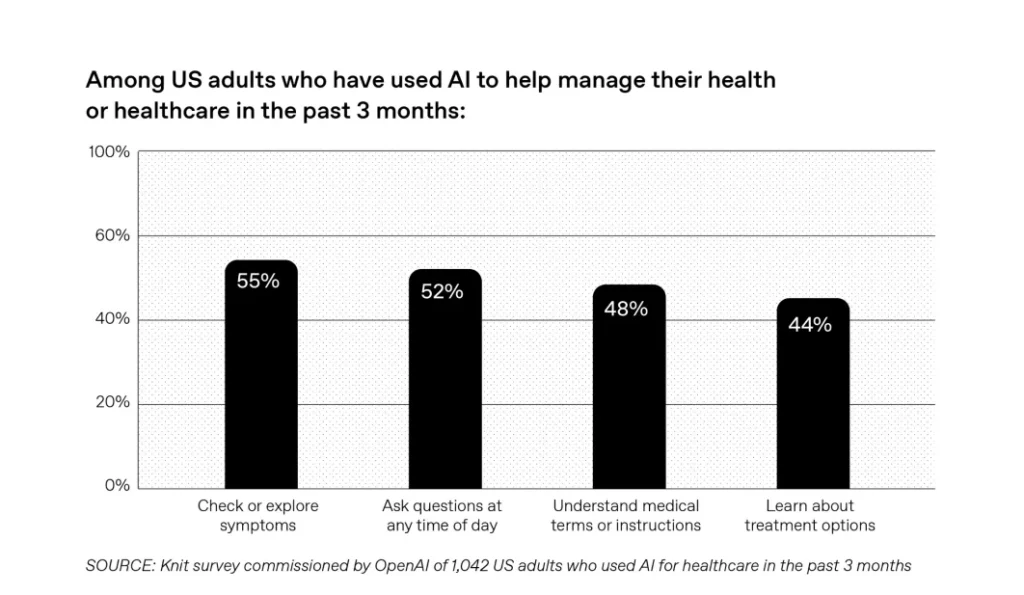

La compañía destaca que se trata de una respuesta a una demanda masiva: según sus propios datos, más de doscientos millones de usuarios preguntan sobre salud al chatbot cada semana, y que la herramienta busca ayudar los pacientes a entender resultados de laboratorio, a prepararse para citas médicas o a comparar opciones de seguros.

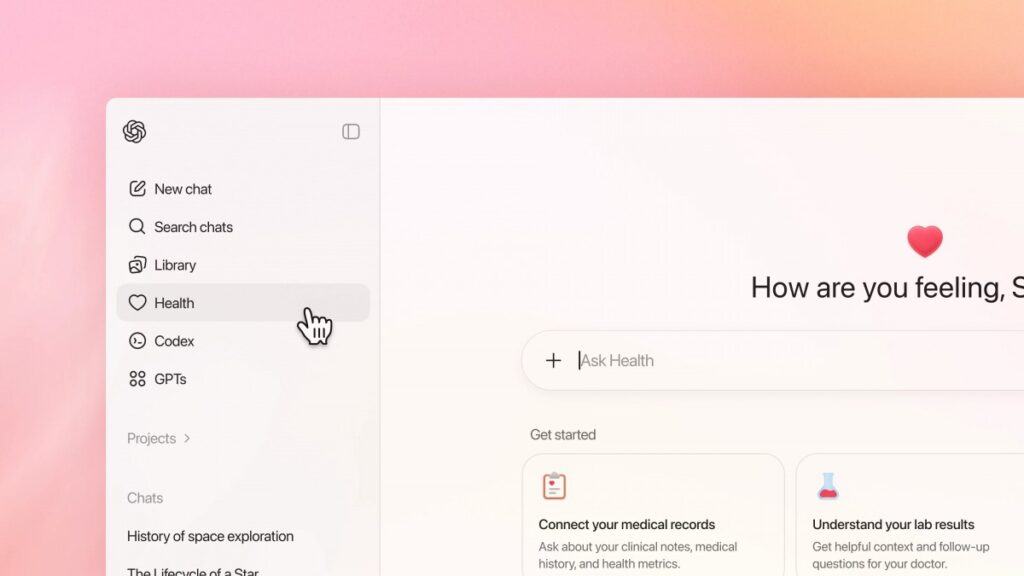

¿Qué es y con qué se conecta?

El objetivo es claro: permitir que el asistente analice datos reales y ayude a entenderlos en lenguaje humano, en lugar de solo mostrar cifras frías. Para ello, los usuarios pueden conectar servicios de terceros como Apple Health, MyFitnessPal, Peloton, WeightWatchers y otros.

Una vez conectado, ChatGPT Health actúa como un intérprete entre el usuario y el sistema sanitario. Puede explicar resultados de análisis de forma comprensible, interpretar las métricas de tus wearables, resumir instrucciones médicas o incluso detectar patrones en tu sueño, actividad o alimentación. Eso sí, OpenAI deja claro que no sustituye a un médico.

La privacidad por bandera: No entrenarán a la IA con tus datos médicos

OpenAI sabe que la salud es un terreno extremadamente delicado. Por eso, han implementado medidas de seguridad específicas: cifrado, aislamiento de estas conversaciones médicas y, lo más importante, una promesa explícita de no usar estos chats para entrenar sus modelos.

La mala noticia: Europa se queda fuera (por ahora)

El despliegue está siendo deliberadamente conservador. Actualmente, la disponibilidad es limitada para un pequeño grupo de usuarios y excluye explícitamente al Espacio Económico Europeo, Reino Unido y Suiza. Además, funciones avanzadas como la conexión con registros médicos históricos solo están disponibles en EE.UU.

La crítica técnica del Gurú: el peligroso juego de la inferencia probabilística en un entorno clínico

Desde una perspectiva estrictamente técnica, el lanzamiento de ChatGPT Health no es solo una nueva feature, es un salto al vacío arquitectónico y ético. OpenAI está intentando mover un Modelo de Lenguaje Grande (LLM) —que por definición es un motor de inferencia probabilística diseñado para generar texto plausible— a un dominio (la salud) que exige precisión determinista.

El verdadero desafío técnico aquí no es la conexión de APIs con Apple Health o MyFitnessPal; eso es trivial. El problema radica en la normalización y el grounding de datos heterogéneos con distintos niveles de fiabilidad clínica. Mezclar datos médicos estructurados (HL7/FHIR vía b.well) con el ruido inherente de los sensores de un wearable de consumo o el input manual de un usuario en una app de dietas crea un pipeline de datos caótico. ¿Cómo pondera el modelo un resultado de laboratorio frente a una medición de frecuencia cardíaca errónea de un reloj inteligente? El riesgo de «alucinación» aquí no es que el modelo invente un dato, sino que establezca correlaciones espurias entre métricas dispares, ofreciendo una «interpretación» que, para el usuario no experto, suena a diagnóstico clínico.

Además, la promesa de privacidad de «no usar datos para entrenamiento» requiere un escrutinio técnico profundo. No basta con una política de privacidad. La comunidad necesita entender la arquitectura subyacente: ¿Estamos hablando de entornos de ejecución aislados (sandboxes) para cada sesión de salud? ¿Se están utilizando técnicas de RAG (Retrieval-Augmented Generation) sobre índices cifrados que se purgan instantáneamente? La exclusión deliberada de Europa no es una simple fase de despliegue; es una admisión tácita de que la infraestructura actual probablemente no cumple con los rigurosos requisitos del RGPD para el procesamiento de categorías especiales de datos a gran escala. OpenAI pide un acto de fe ciega en su «caja negra» en el sector donde la transparencia es más crítica que en ningún otro.

La promesa de privacidad es clave, pero la confianza habrá que ganársela día a día. ¡Te leemos en los comentarios! Y no te olvides de seguir a Gurú Tecno en YouTube, Instagram y Facebook.